Obsidian 本地 AI 知识库实战指南

前段时间 Andrej Karpathy 开源了一个他的本地知识库管理方法 LLM wiki 广受好评,只靠一个文档就获得了Github 5k star。

https://gist.github.com/karpathy/442a6bf555914893e9891c11519de94f

Andrej Karpathy(安德烈・卡帕西) 可以说是当今全球最具影响力的深度学习、计算机视觉与大模型专家之一。

他跟着奥特曼、马斯克那帮人一起创办了 OpenAI 是最早那批核心成员之一。

还去了特斯拉专门管自动驾驶AI,一手把特斯拉那套“只靠摄像头不靠激光雷达”的方案做起来的就是他。

在这个方法里面提到了Obsidian+LLM大模型的知识库。

Obsidian 是一款本地笔记工具记录的文件类型是Markdown格式。

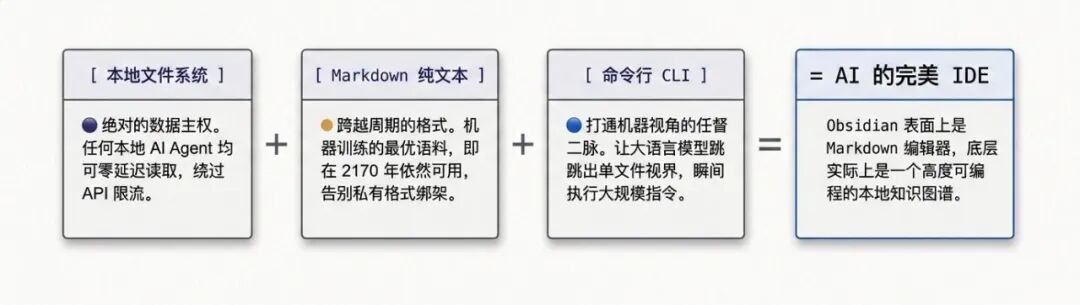

它对比云端笔记 Obsidian 将笔记保存为本地纯文本 Markdown 格式。这既保证了数据的主权永不过时,也完美契合了 AI Agent原生读取和修改的需求,打破了云端的 API 限制。

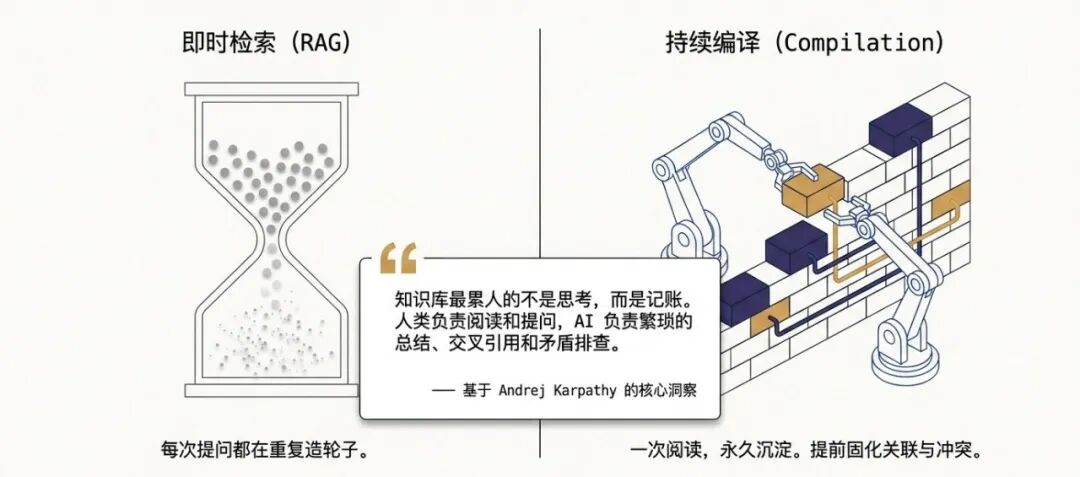

传统知识库用 RAG 模式每次提问 AI 都在重头找片段拼凑,而 LLM Wiki 模式主张让 AI 承担将新知识提炼并“编译”成结构化、带双向链接的维基图谱,实现知识的真正复利与累积。

Obsidian 介绍

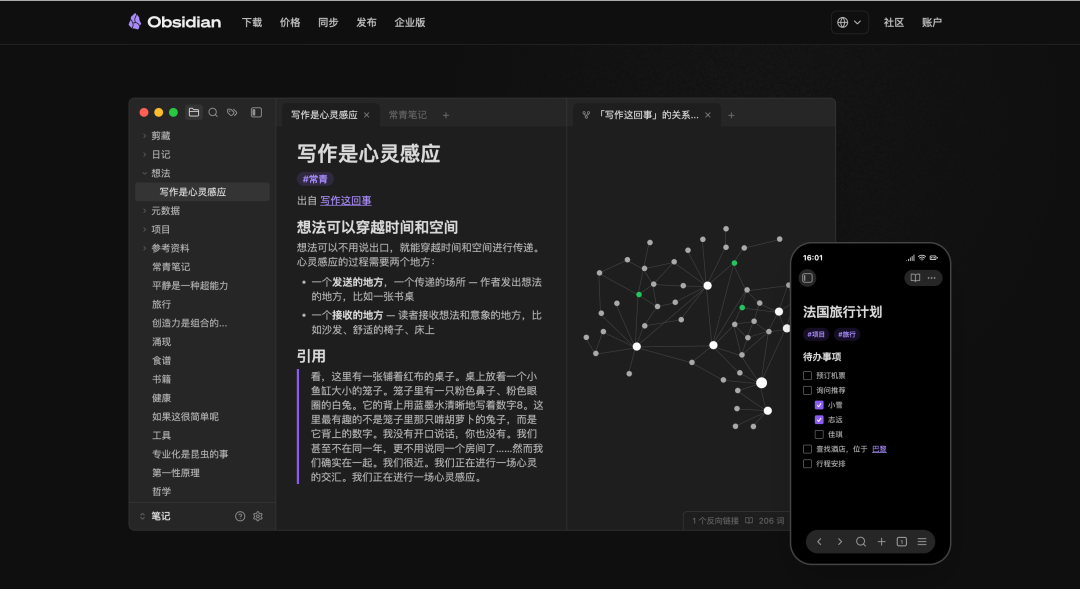

Obsidian 是一款本地知识管理的笔记软件。

下载地址:https://obsidian.md/zh/

在 AI 时代,它凭借独特的架构成为了极具优势的个人知识库工具,其核心特征可以归结为以下3点:

- 核心产品哲学:Obsidian 将数据主权完全交还给用户。你的笔记全部以纯文本 Markdown (.md) 格式保存在本地设备上,而不是被锁在云端服务器或封闭的私有格式中。

- 强大的网状知识结构:传统的笔记软件多采用树状文件夹结构,而 Obsidian 的一大核心是双向链接功能。如果你的笔记之间存在关联,它会自动建立起错综复杂的网状知识拓扑结构。

- 与 AI 的天生契合:由于笔记就存放在本地且格式是 AI 最熟悉的 Markdown,本地的 AI 可以直接、瞬间地读取、分析和修改你的这些文件。再配合进阶的 Obsidian CLI(命令行接口),AI 甚至能直接看懂你整个知识库中的网状链接关系,帮你洞察思维盲区并生成结构化的知识图谱。

如何搭建 AI 本地知识库?

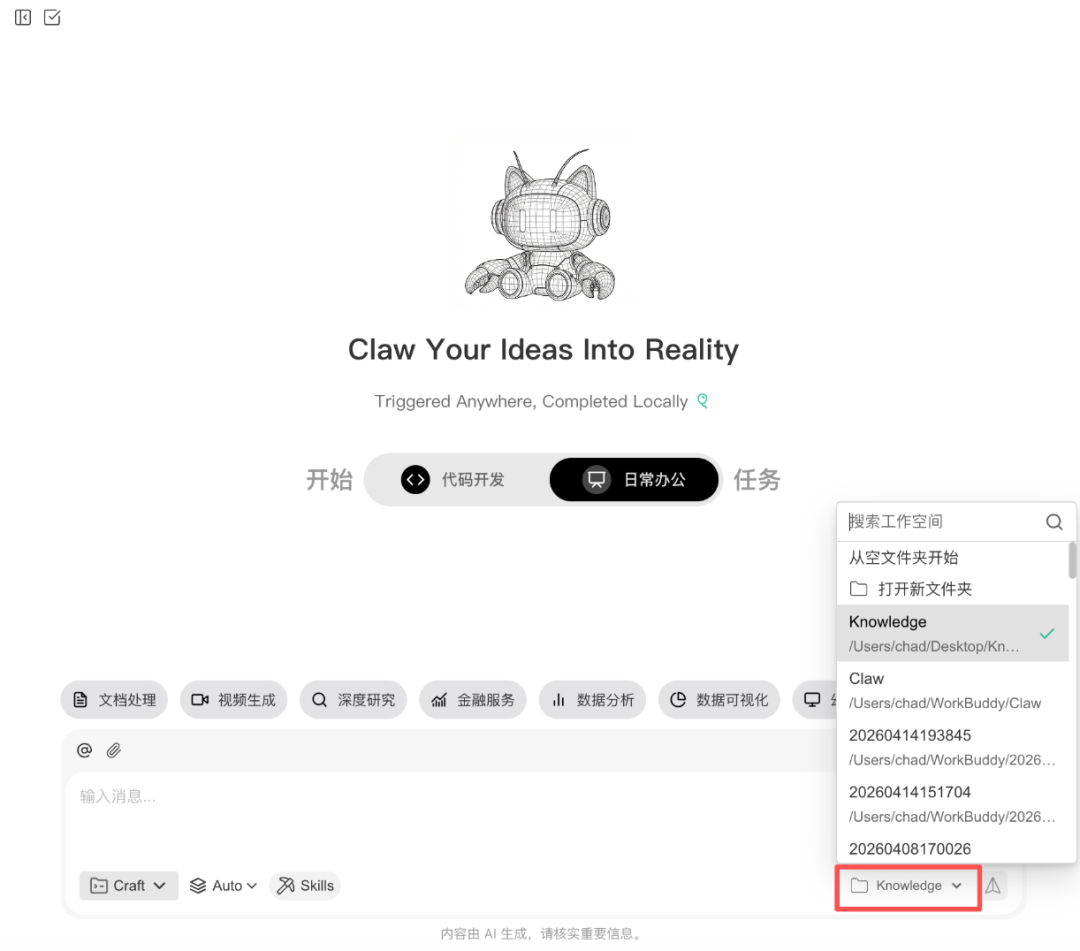

先下载 Obsidian 然后在桌面创建一个AI知识库的文件夹(名字随便取,我这边取名叫做Knowledge),然后用Obsidian打开创建好的文件夹。

接下来我们可以用之前学习过的 WorkBuddy (你可以用其他的QClaw、CodeBuddy、Claude Code 、Codex只要是能操作本地文件的Agent都可以)也选择这个文件夹。

选择之后直接和它说,让它去学习llm wiki 这个教程帮我们搭建好文件的目录结构。

你去学习一下

https://gist.github.com/karpathy/442a6bf555914893e9891c11519de94f

在这个文件夹中搭建相关知识库。然后它就会自己学习,自己根据学习内容进行文件夹与相关文件的创建。

知识库核心逻辑

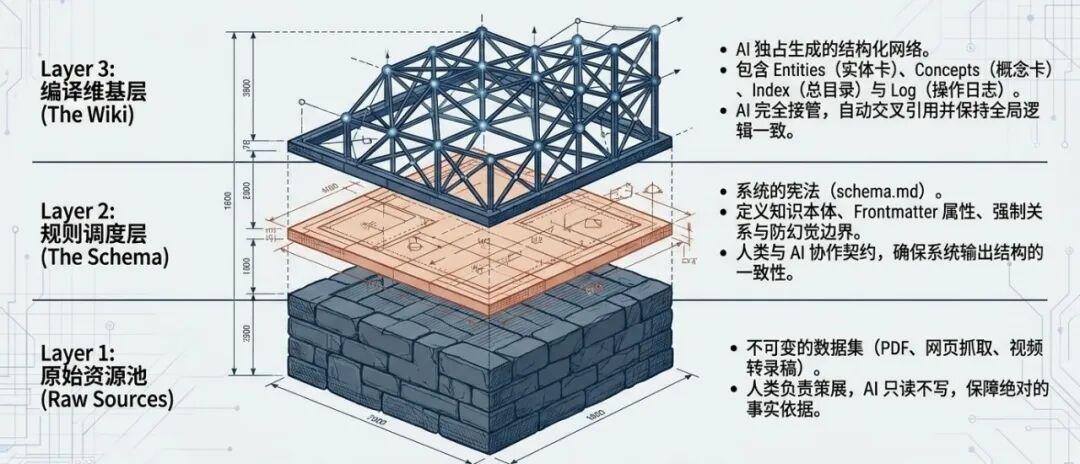

在这里我们了解下这个知识库的核心逻辑:

根据 Karpathy 的理念,一个成熟的 LLM Wiki 系统由三个核心数据层和两个辅助文件构成。

这套架构确保了知识的有序性,避免了长期的“大模型遗忘症”。

三层文件结构

- 原始资源层 (Raw sources):这是你的事实仓库。存放你收集到的外部 PDF、网页剪藏、播客录音转录稿(如使用 Whisper 转录的内容)等。原则:只读不改。 AI 只能从中读取信息,绝不能修改它们。

- 维基文件层 (The wiki):整个系统的核心。这里存放着由 AI 提取、阅读原始资源后,自动生成的结构化 Markdown 文件。这些文件会按“实体(如某个人物、某家公司)”、“概念(如复利思维)”、“对比分析”进行分门别类,并且充满着密集的双向链接。

- 模式与规则层 (The schema):系统的大脑配置文件。比如创建一个名为

CLAUDE.md的文件,在里面用自然语言写下你对 AI 的“指令”。你需要在这个文件里向 AI 约定:维基的目录结构是什么、如何使用 Frontmatter 标签、创建链接时需要遵循什么规范(必须使用 Obsidian 语法的双向链接)。

两个必不可少的 AI 辅助文件

如果每次提问都要 AI 去通读几百个 Markdown 文件,不仅速度极慢,还会瞬间耗尽 Token 的上下文额度(Token 暴雷)。因此,我们需要让 AI 在日常操作中自动维护两个特殊页面:

- 索引表 (index.md):这是维基的花名册。AI 每次创建新页面,都必须在这里追加一行,写明“页面链接 + 一句话摘要”。当 AI 想要回答你的问题时,它只需先用极低的算力扫一眼

index.md,就能精准定位到需要深度阅读的 2-3 篇笔记。 - 日志库 (log.md):AI 的时间线记忆。按时间顺序追加记录,例如“2026-04-14,摄取了文件A,创建了概念B,添加了链接C”。这不仅能让你随时审查 AI 做了什么,也能帮助 AI 找回它的“短期记忆”,知道最近系统发生了哪些变化。

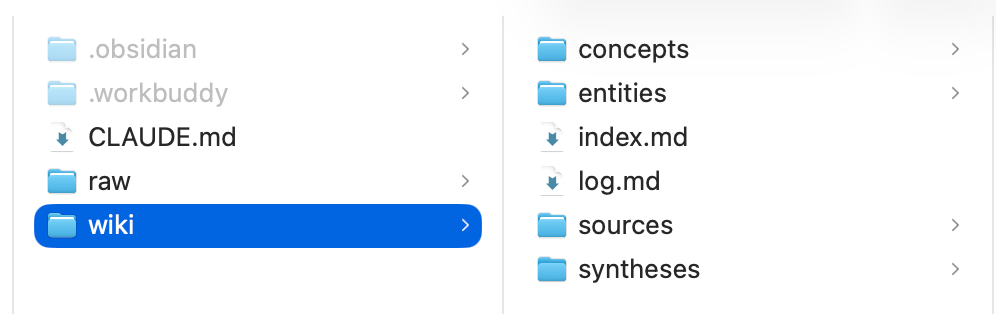

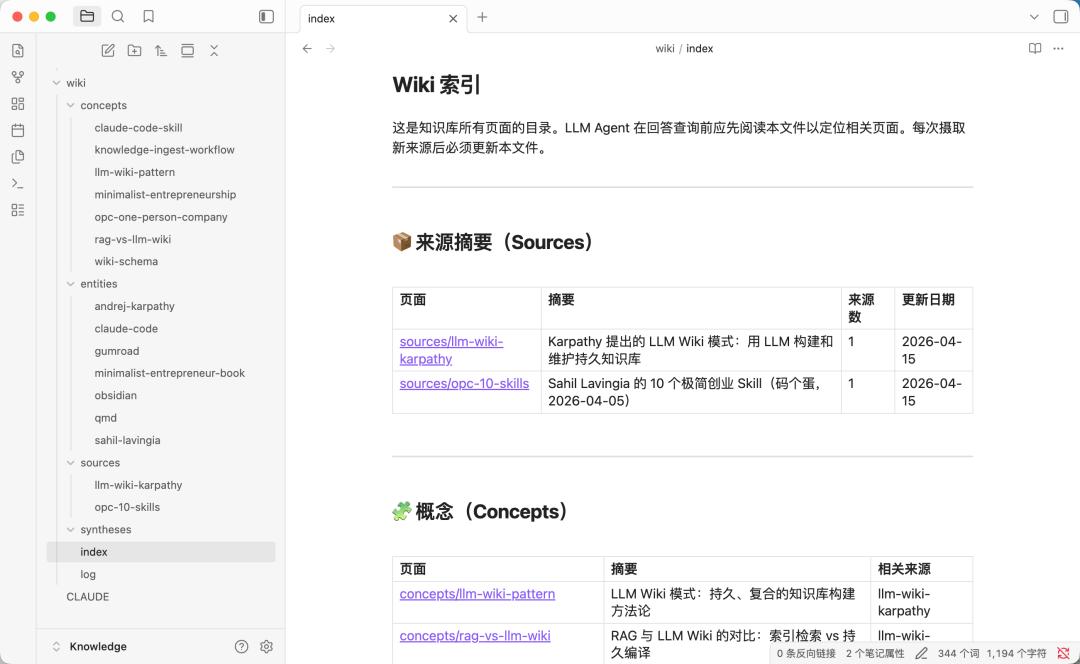

它不仅创建好了相关的文件夹以及记录文件,还自己把给他的学习文档进行了拆解。

Knowledge/

├── CLAUDE.md ← Schema 配置(知识库的"大脑")

├── raw/

│ ├── assets/ ← 图片附件存放处

│ └── llm-wiki-karpathy-2026-04-04.md ← Karpathy 原文归档

└── wiki/

├── index.md ← 所有页面的内容导航

├── log.md ← append-only 操作日志

├── concepts/ ← 4 个概念页面

│ ├── llm-wiki-pattern.md

│ ├── rag-vs-llm-wiki.md

│ ├── wiki-schema.md

│ └── knowledge-ingest-workflow.md

├── entities/ ← 3 个实体页面

│ ├── andrej-karpathy.md

│ ├── obsidian.md

│ └── qmd.md

├── sources/ ← 来源摘要

│ └── llm-wiki-karpathy.md

└── syntheses/ ← 待填充(存放综合分析)

我们可以用Obsidian查看这里面的内容。

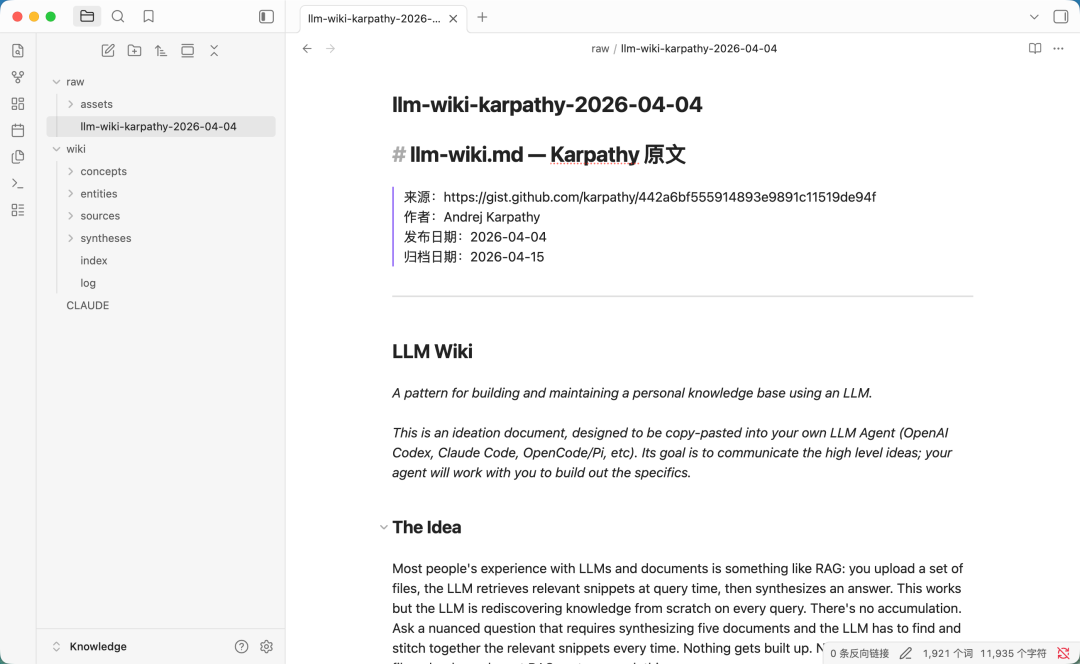

先看看 raw(原始内容)。

它存放了llm-wiki的学习教程。

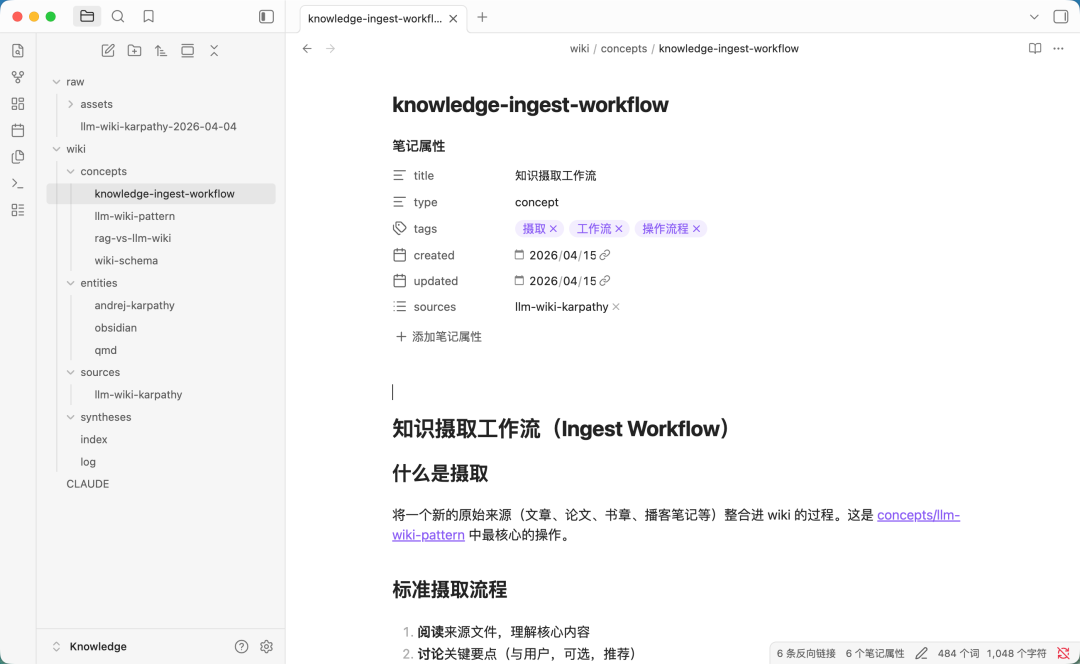

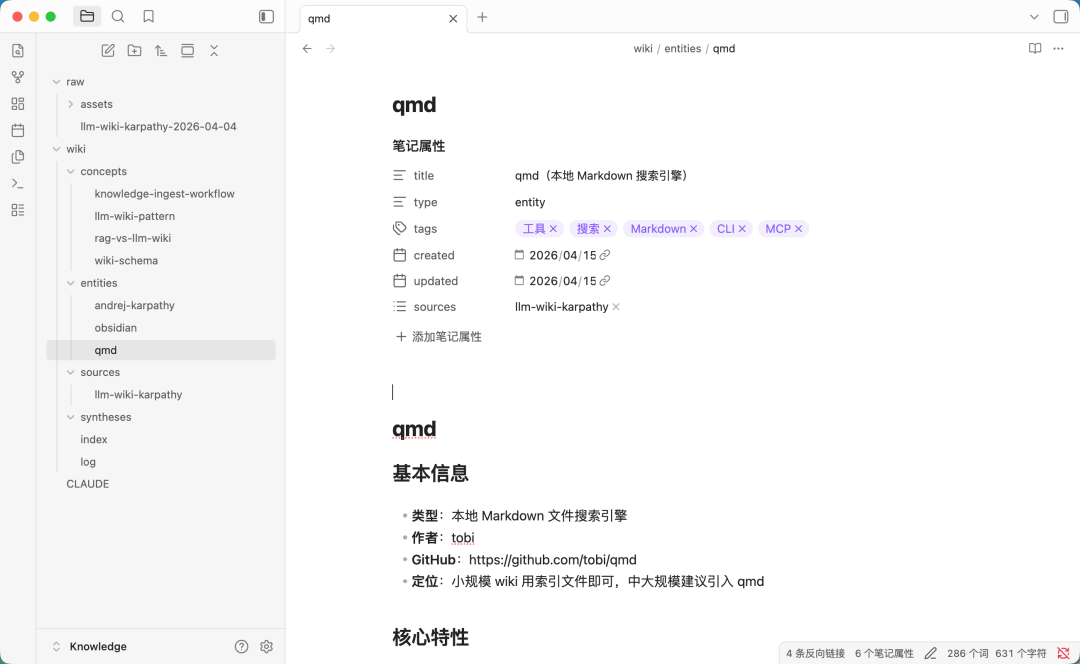

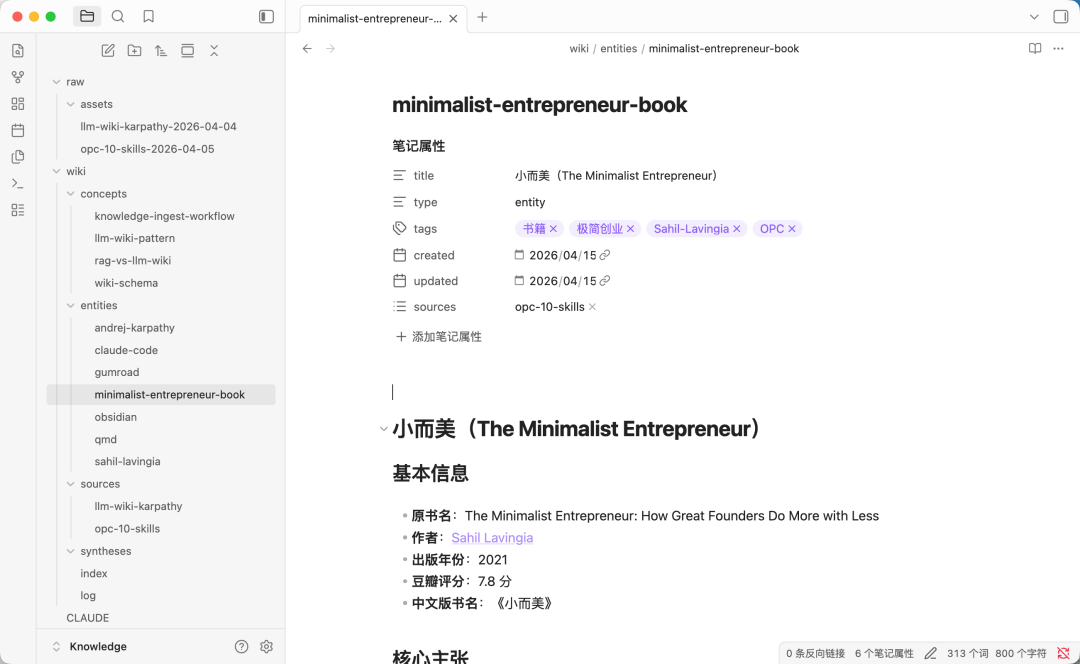

在看看wiki(AI处理后的内容),给内容打上了标签、取了标题以及做了内容的提炼和双链。

然后还有log文件,每一次的操作都会被记录到这里。

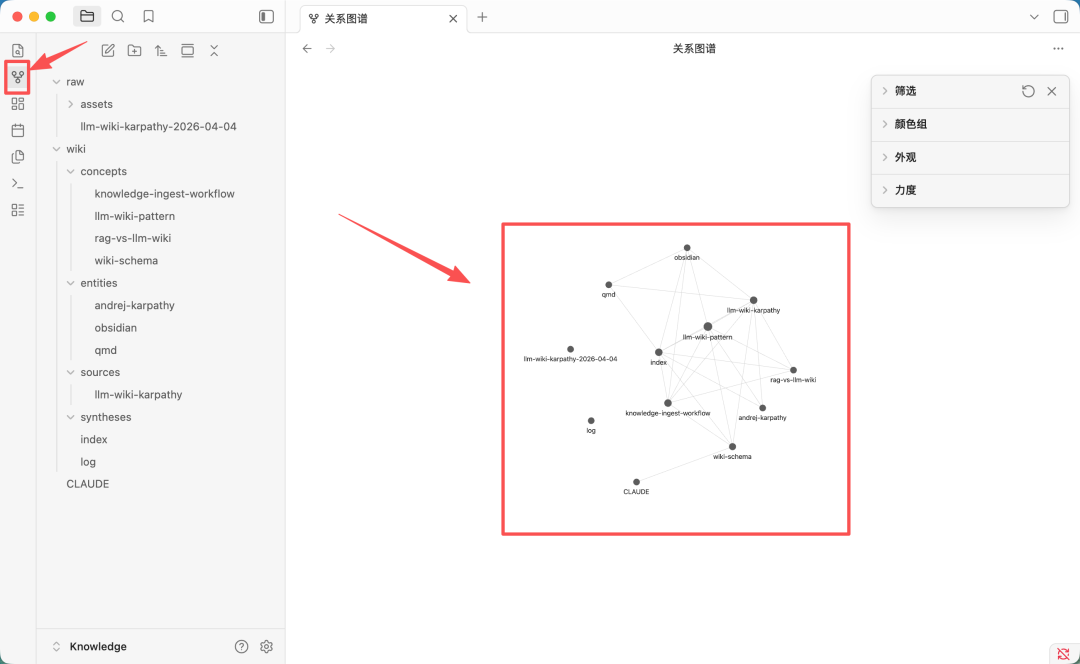

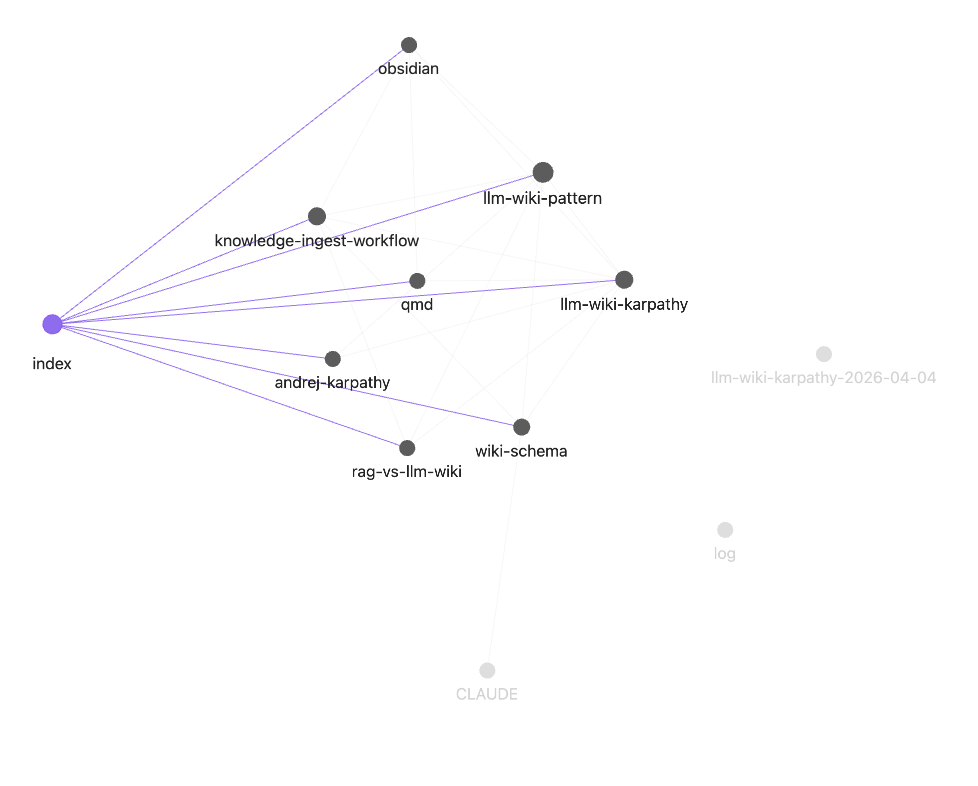

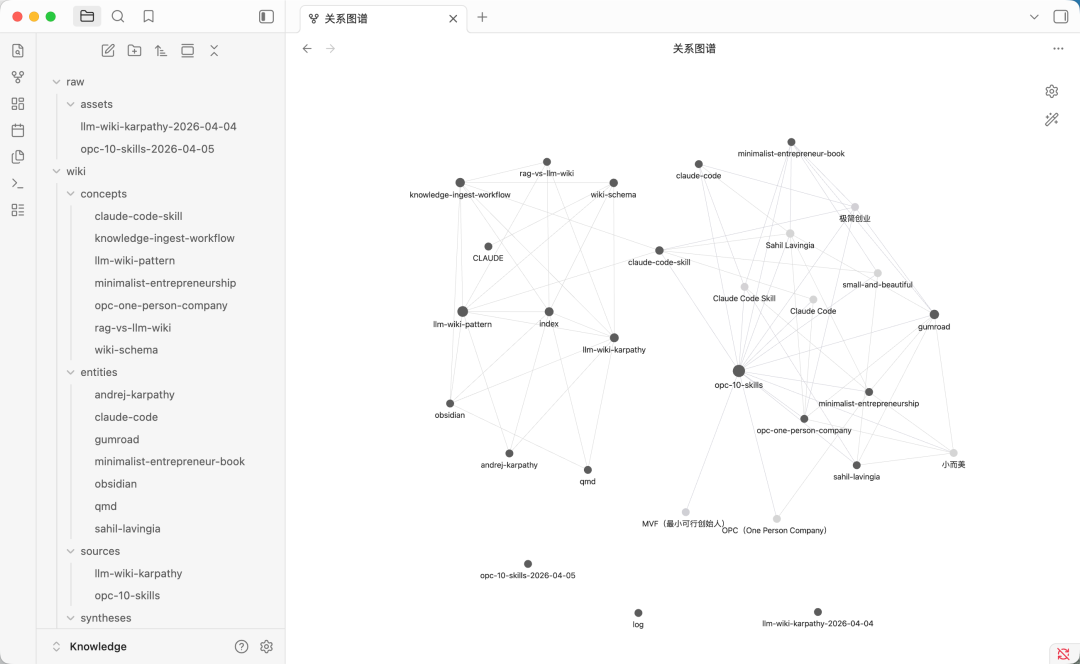

然后还可以切换成关系图谱模式进行学习。

可视化笔记之间的关系。

通过直观的交互式图谱,发现思维中隐藏的模式。

每个知识点可以随便拖拽清晰的查看与这个点的相关知识。

还点击查看里面的具体内容。

系统搭建完毕后,你可以通过支持本地文件的 AI Agent 进行知识管理了。

知识库管理操作

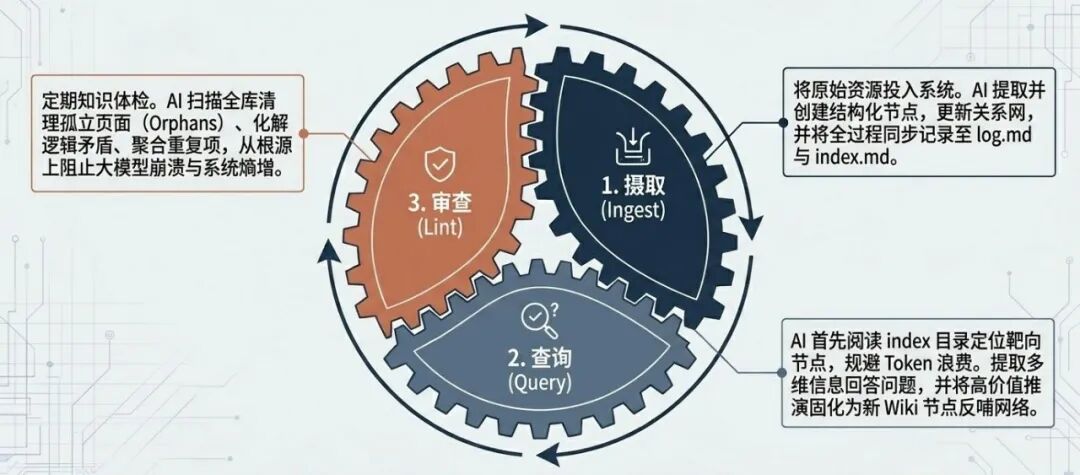

日常的知识管理被精简为了三个核心动作:

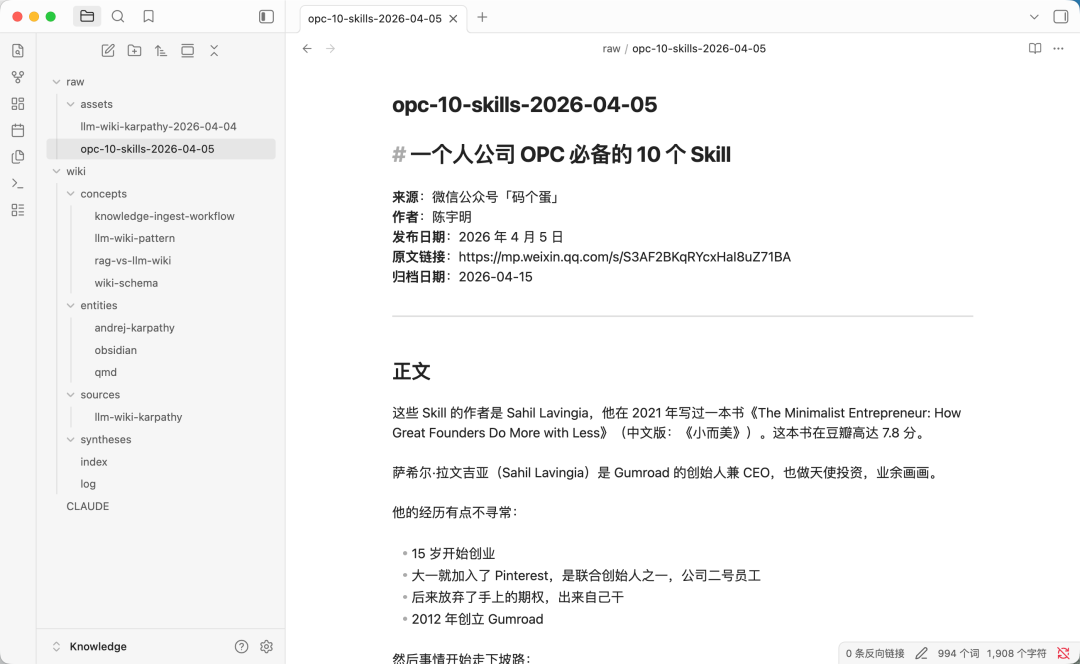

- 摄取 (Ingest):知识的原子化提炼

当你读到一篇好文章你可以直接把链接让AI去整理成md格式和提炼。

帮我把这篇文章 https://mp.weixin.qq.com/s/S3AF2BKqRYcxHaI8uZ71BA

整理成md格式放入raw文件夹,然后根据 Schema 规范,提炼这份新资料。

AI会先处理文章将其隔离处理成md格式。

然后仔细阅读原文,将其拆解为多个独立的知识点。它会检查这个概念是否已经存在于 Wiki 中,如果不存在就新建页面;如果存在,就把新的观点补充进去。

随后,AI 会在相关的页面之间打上双向链接(如用 [[概念A]] 链接到 [[概念B]])。

最后自觉地去更新 index.md 和 log.md。

这不仅节省了你大量的整理时间,更重要的是 AI 能够轻易在一瞬间关联 15 个甚至更多的文件。

- 问答 (Query):知识的涌现与固化

当你在思考某个新问题时,直接向 AI 提问:

基于我的 wiki 知识库, 我最近创业遇到了推广问题,

推荐我一个能帮助我的 skill

AI 会翻阅内部的 Wiki,综合多篇卡片笔记为你生成带引用的答案,极大提高了准确率。

如果它的回答你觉得不错,你可以直接和它说。

非常好,请把它固化为一篇新的 wiki 笔记保存下来。

通过这种方式,你的灵感被永久沉淀,你的知识库在日常问答中实现了二次生长。

- 定检与审查 (Lint):AI 驱动的知识库体检

传统笔记的弊端在于“记完就吃灰”,内部充满了死链接和矛盾的信息。

现在你可以定期(如每周一次)对 AI 说。

对我的知识库进行 Lint 审查。

AI 会自动扫描全库,找出没有关联任何页面的“孤立页面(Orphan pages)”,梳理出相互矛盾的知识点,甚至建议你将两个高度相似的概念页面进行合并。

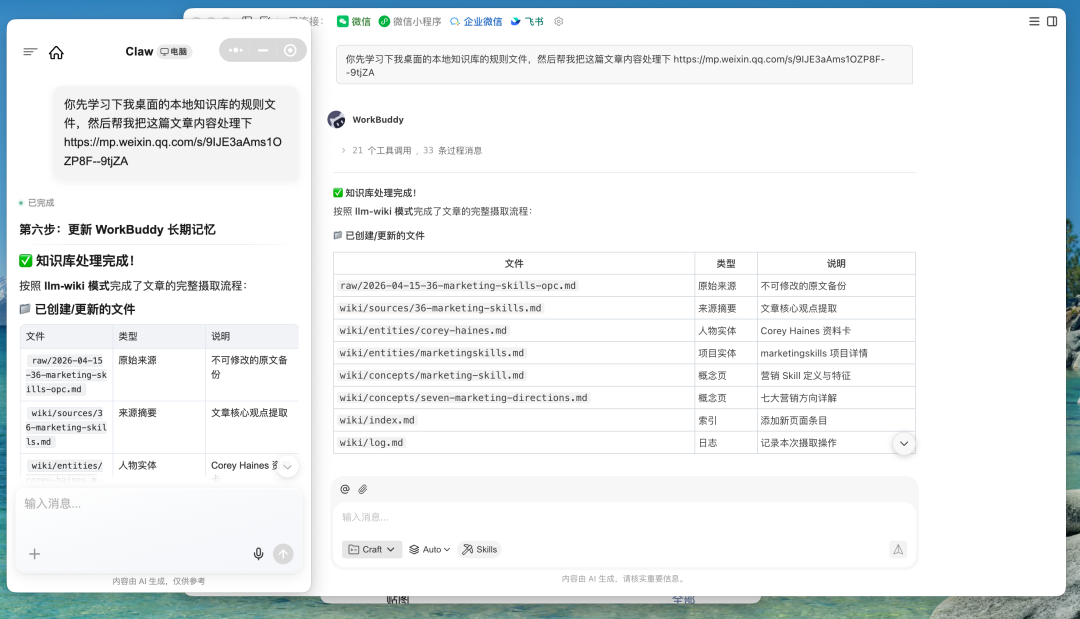

结合腾讯版本地“龙虾”可以被微信接入,我们就可以在手机上轻松的阅读信息让电脑上的AI为我们管理知识库了。

在这里需要注意,一开始它不知道我们的知识库的存在,手机和电脑的对话不是同一个,所以需要先让它去了解。

你先学习下我桌面的本地知识库的规则文件,然后帮我把这篇文章内容处理下

https://mp.weixin.qq.com/s/9IJE3aAms1OZP8F--9tjZA

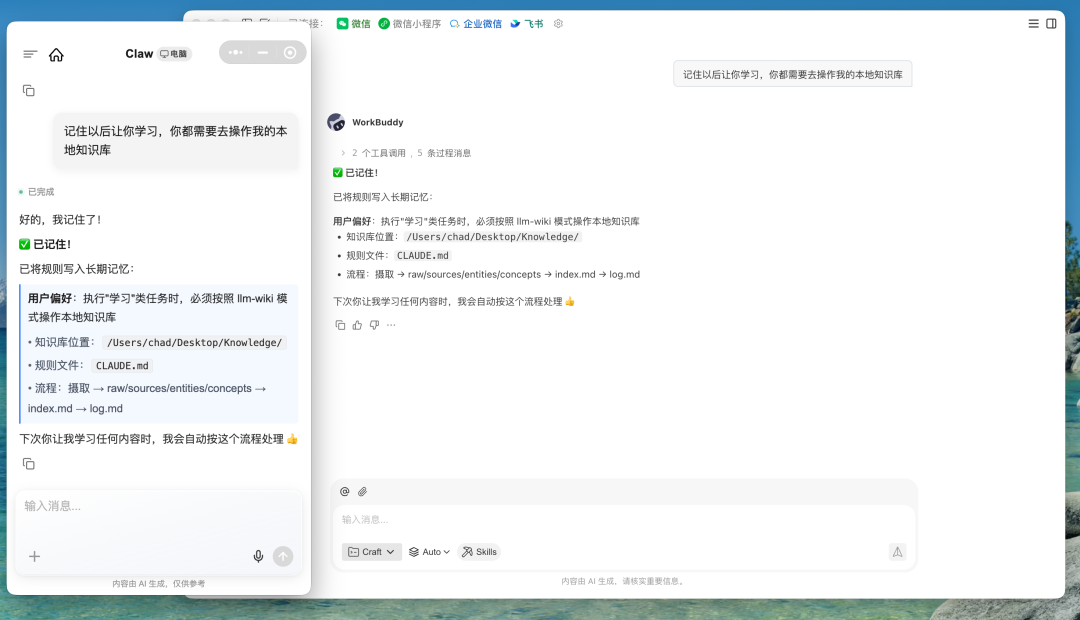

处理过一遍之后再告诉它,让它记住这个操作。记住以后让你学习,你都需要去操作我的本地知识库

到这里我们AI本地知识库的搭建和使用就完成了。

最后

我想说在正式用这套AI知识库系统之前,一定要注意以下 3 点:

1. 别指望 AI 帮你“从零学习” 这套系统更适合你学完之后,用来整理、复习和建立连接,而不是直接拿来入门。

2. 别盲目堆资料 让 AI 一口气生成几百个词条,但你自己不看,其实没啥用。

3. 你才是大脑,AI 只是工具 AI 是加速器,不是替代品。 方向、判断、取舍这些事,还是得你来。

AI 可以帮你整理知识,但不能替你思考。

本文参与 腾讯云自媒体同步曝光计划,分享自微信公众号。

原始发表:2026-04-23,如有侵权请联系 cloudcommunity@tencent.com 删除

评论

登录后参与评论

推荐阅读

目录