解锁边缘 LLM:Jetson Orin 内存管理与优化全攻略

原创解锁边缘 LLM:Jetson Orin 内存管理与优化全攻略

原创用户4730701

发布于 2026-04-28 14:50:28

发布于 2026-04-28 14:50:28

——以 Llama-3.1-8B 实战透视大模型推理底层生命周期

在边缘设备上跑大语言模型(LLM),内存就是一切。 OOM、卡顿、启动崩溃、性能不稳定……90% 的问题都来自对「内存生命周期」与「统一内存架构」不理解。

本文基于 Jetson Orin 官方优化文档,用最直白、可落地、工程化的方式,完整拆解 LLM 推理五阶段内存行为,并给出 AGX Orin / Orin NX / Orin Nano 通用的优化方案。

1. 基准场景设定(所有优化的基础)

本文所有分析、测试、结论,均基于以下真实生产环境:

- 硬件:Jetson AGX Orin 64GB

- 内存规格:LPDDR5 256-bit,带宽 204.8 GB/s

- 模型:Llama-3.1-8B-Instruct(80 亿参数)

- 量化格式:Q4_K_M(4bit GGUF)

- 推理场景:常规对话

- 上下文长度:2048 tokens

- 对比框架:llama.cpp(CUDA)、TensorRT-LLM

这里选择 8B 模型,是因为这是边缘设备能稳定、实用、商用的最大模型规模。

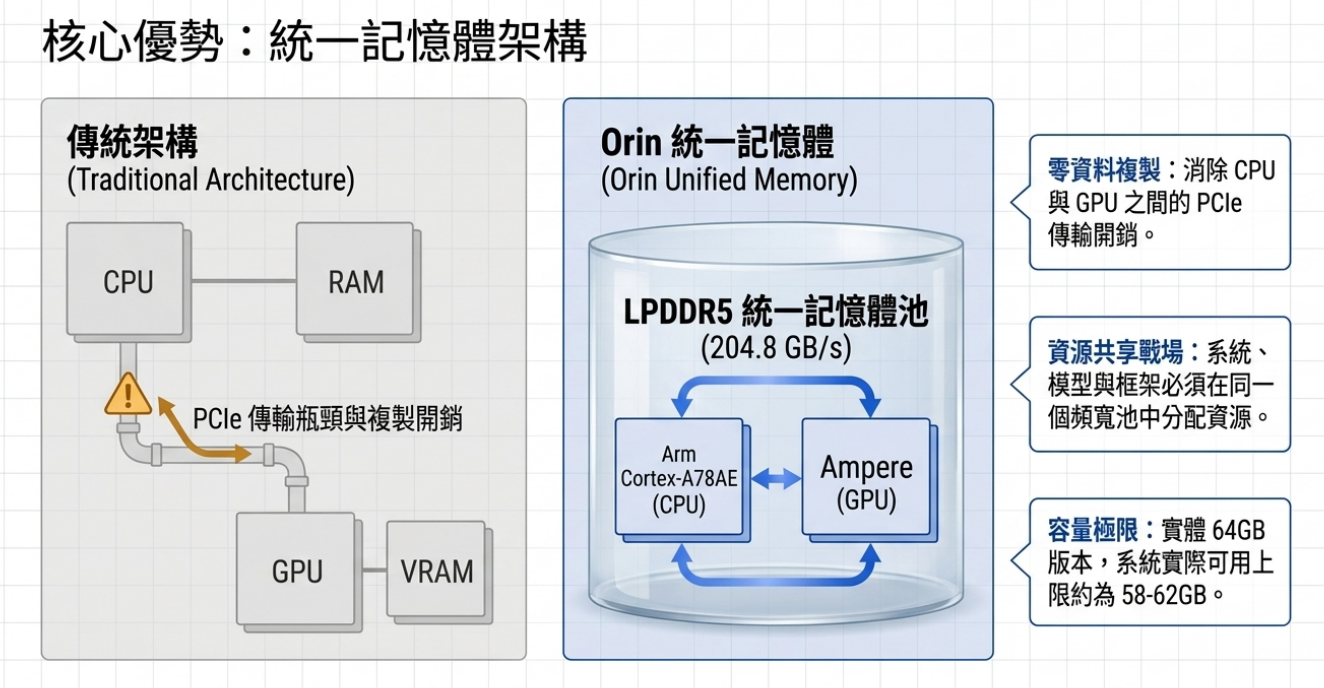

2. Jetson Orin 核心优势:统一内存架构

Orin 的内存系统并非传统「CPU 内存 + GPU 显存」分离架构,而是Unified Memory(统一内存)。

传统架构问题

- CPU / GPU 内存分离

- 数据必须通过 PCIe 搬运

- 拷贝开销大、带宽浪费、资源无法共享

Orin 统一内存优势

- 零数据拷贝:CPU/GPU 直接访问同一块物理内存

- 超高带宽:204.8 GB/s 满足 LLM 大量权重读取

- 单一资源池:系统、模型、框架全部共享同一块 RAM

使用统一内存的代价:所有资源在同个共享池争夺,只要一处 OOM就会导致整个系统崩溃。

- AGX Orin 64GB:实际可用 58–62GB

- AGX Orin 32GB:实际可用 28–30GB

- Orin NX 16GB:实际可用 ~14GB

- Orin Nano 8GB:实际可用 ~7.6GB

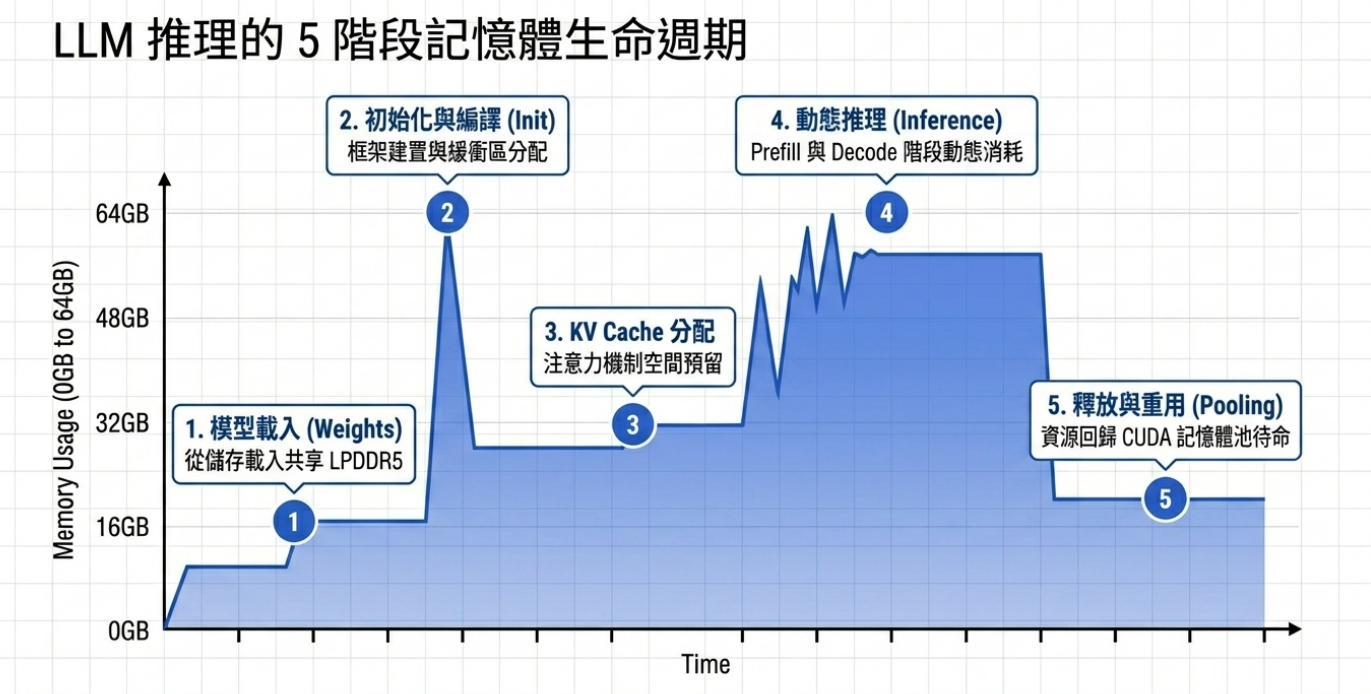

3. LLM 推理五阶段内存生命周期(最核心)

LLM 从加载到执行,会经历五个完全不同的内存行为阶段。 90% 的 OOM 都发生在这里。

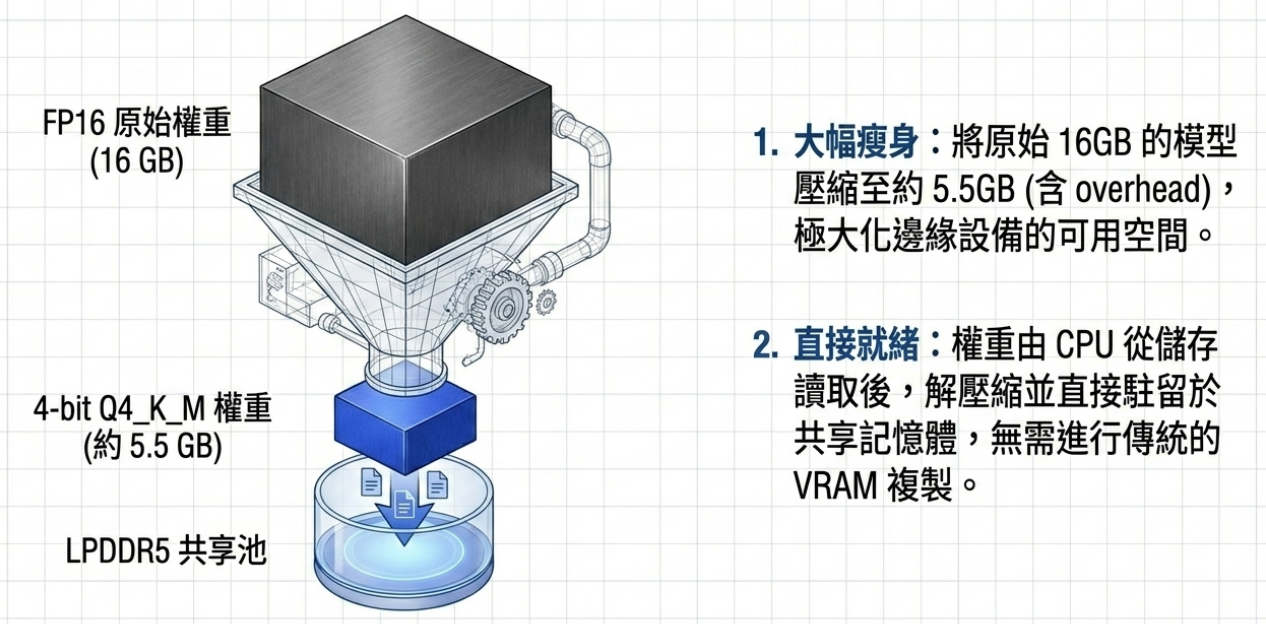

阶段 1:模型加载(Weights Load)

从存储设备读取模型权重,放入共享内存。

- Llama-3.1-8B FP16:16 GB

- 4bit Q4_K_M 量化后:仅 5.5 GB

关键点

- 量化是边缘 LLM 生存基础

- 模型直接加载到 Unified Memory,不需要拷贝到 VRAM

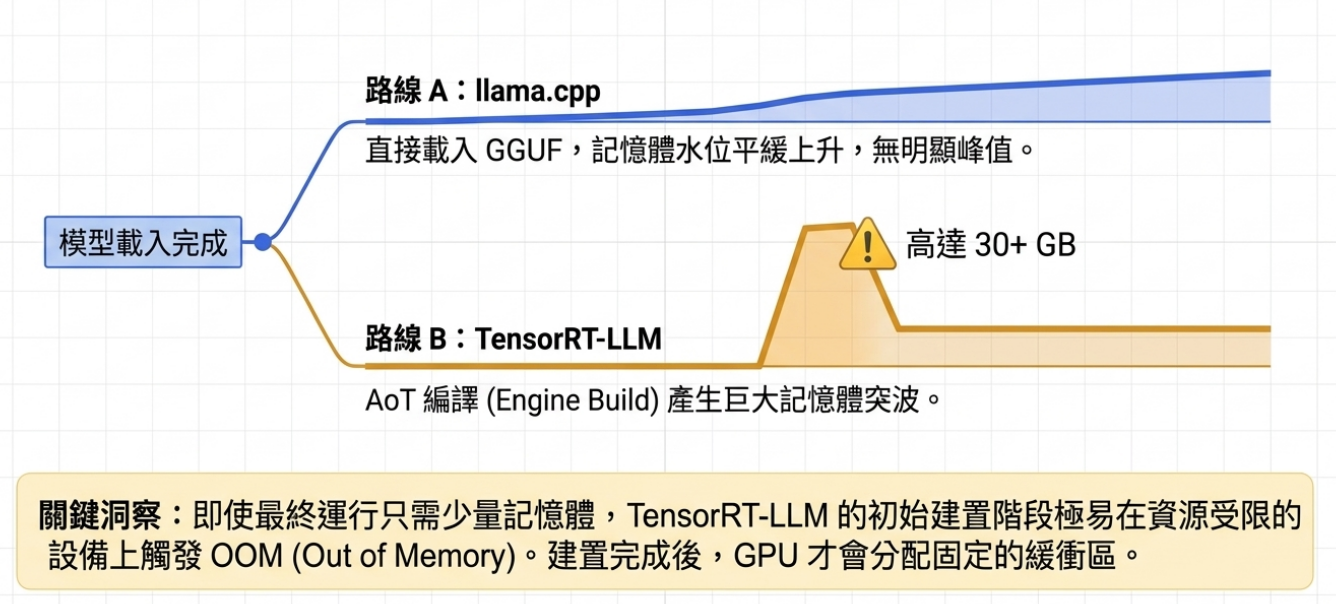

阶段 2:初始化与编译(隐藏内存杀手)

框架启动、缓冲区分配、引擎构建。

llama.cpp

- 直接读取 GGUF

- 内存平缓上升

- 无峰值、不爆内存

TensorRT-LLM

- 必须先做 AoT 引擎编译

- 瞬间内存突增 30GB+

- 资源受限设备(NX 16GB / Nano 8GB)极易直接 OOM

结论

- 小设备 → 优先 llama.cpp

- 大设备 → 可使用 TensorRT-LLM

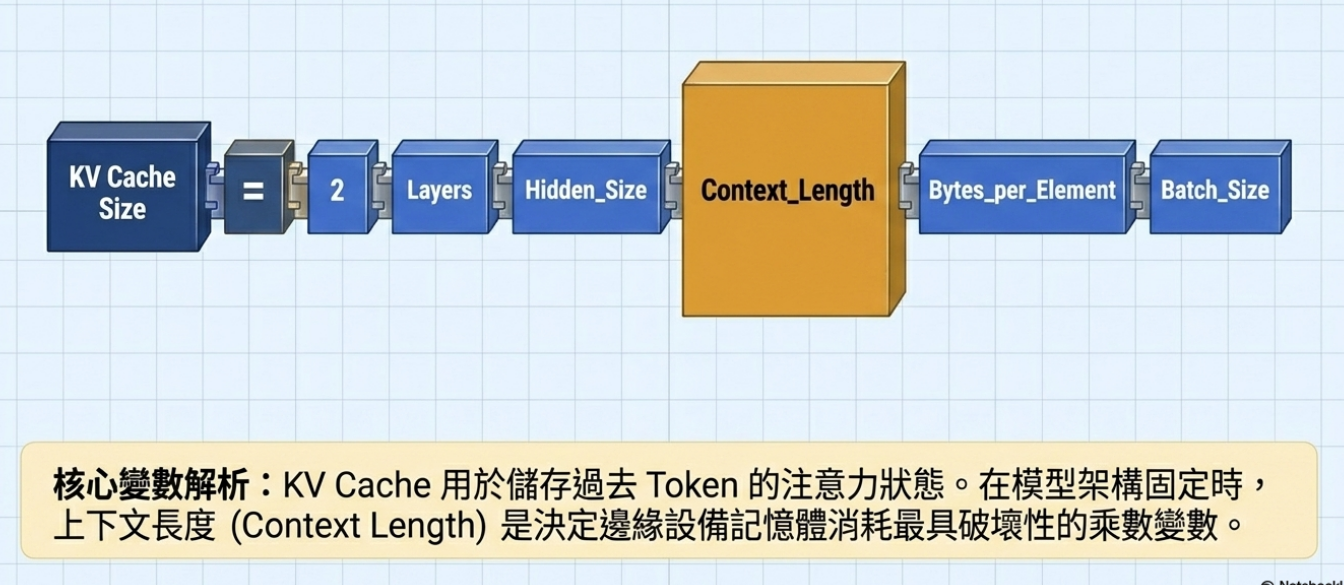

阶段 3:KV Cache 分配(最吃内存)

KV Cache 用于缓存过去所有 token 的注意力状态,是执行期最大内存开销。

计算公式

KV Cache = 2 × Layers × Hidden_Size × Context_Length × Bytes_per_Element × Batch_Size真实代价

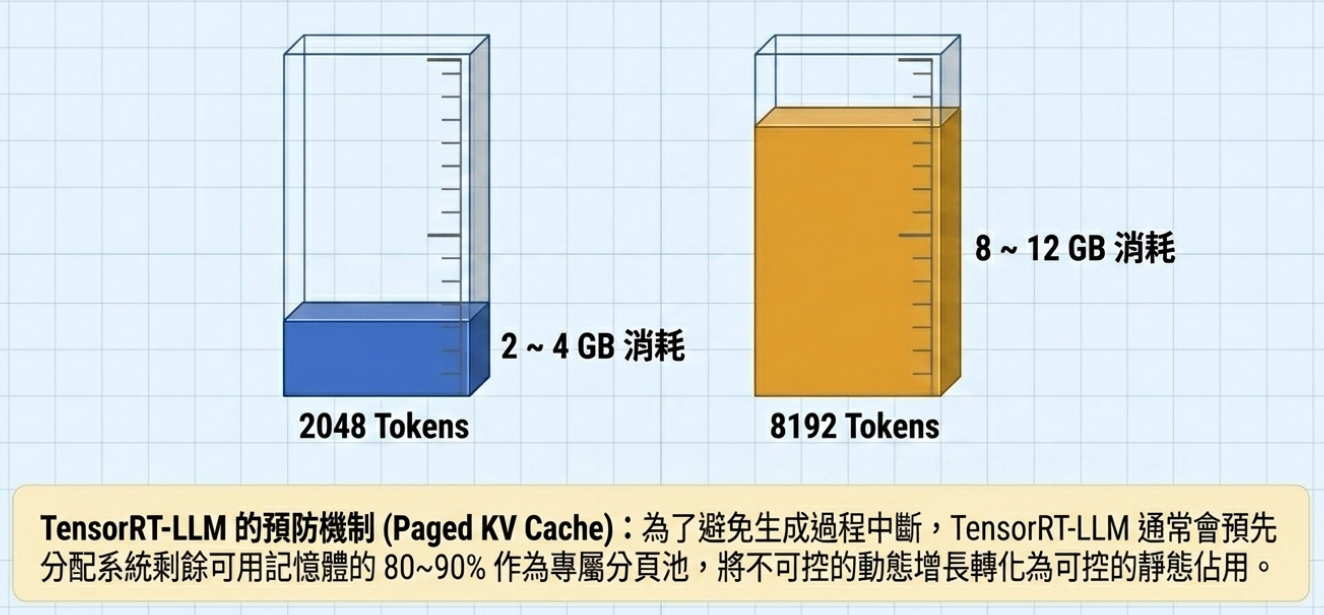

- 2048 tokens:KV Cache ≈ 2–4 GB

- 8192 tokens:KV Cache ≈ 8–12 GB

Context Length 每增加 1 倍,内存几乎线性暴增。

TensorRT-LLM 特殊机制

- Paged KV Cache

- 预先占用系统 80%–90% 剩余内存

- 优点:执行中不会 OOM

- 缺点:其他程序完全无法运行

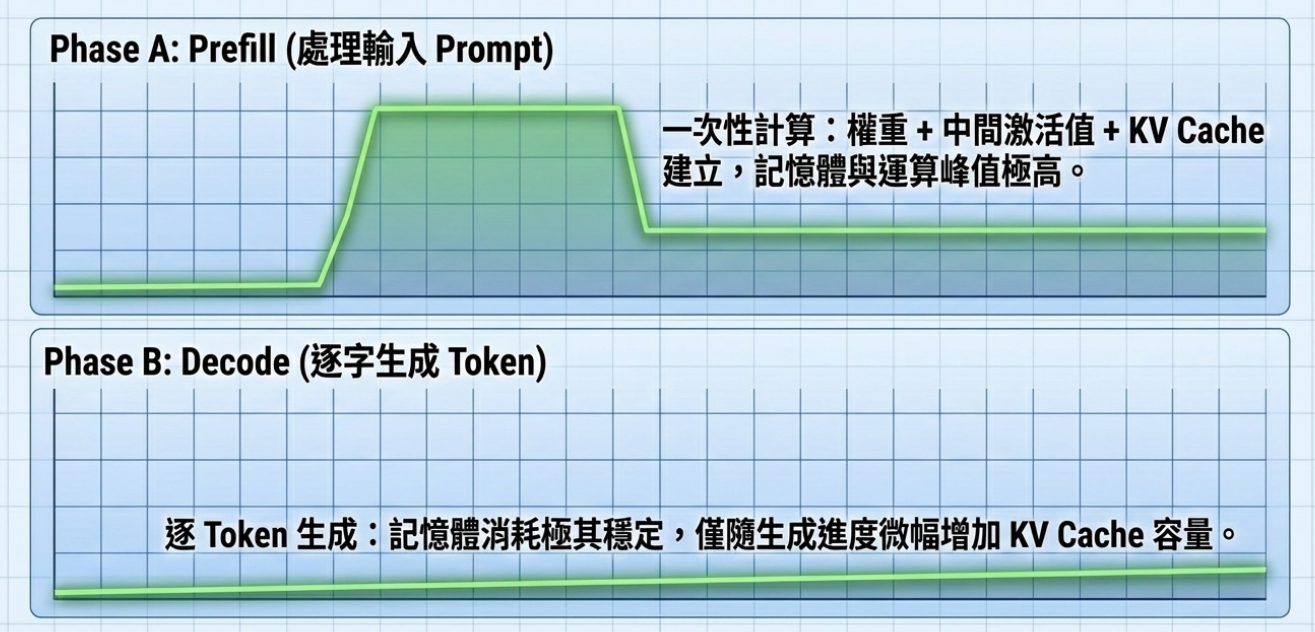

阶段 4:动态推理(Prefill + Decode)

推理分为两个完全不同阶段:

Phase A:Prefill(输入处理)

- 一次性计算整段 Prompt

- 权重 + 激活值 + KV Cache 同时建立

- 内存与运算双高峰

- 最容易 OOM

Phase B:Decode(逐字生成)

- 一次生成 1 个 token

- 仅小幅增加 KV Cache

- 内存极稳定

- 几乎不会爆内存

你感受到的卡顿/崩溃 = 几乎都在 Prefill

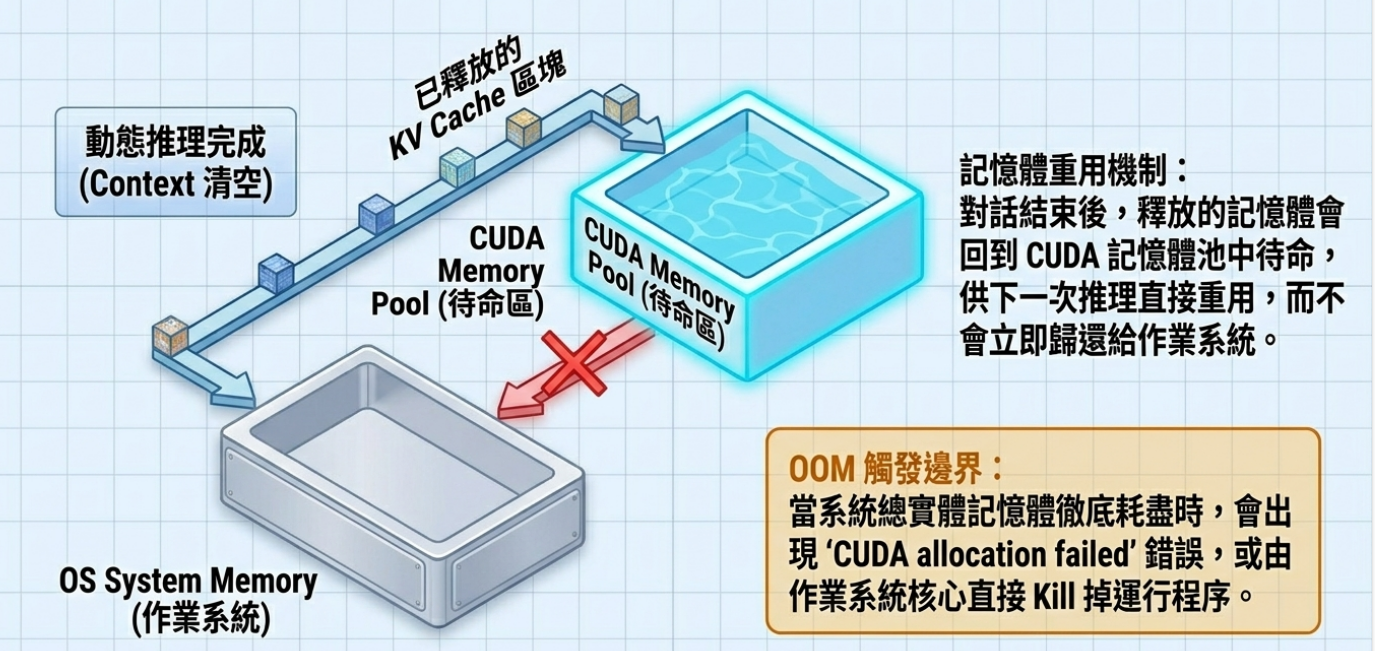

阶段 5:释放与重用(Pooling)

对话结束后:

- KV Cache 释放

- 回到 CUDA 内存池(Pool) 待命

- 不会立刻还给操作系统

优点:下次推理更快

缺点:长时间多轮对话会累积碎片,最终仍可能触发 OOM

当内存耗尽时会出现下面错误信息或系统直接 Kill 进程:

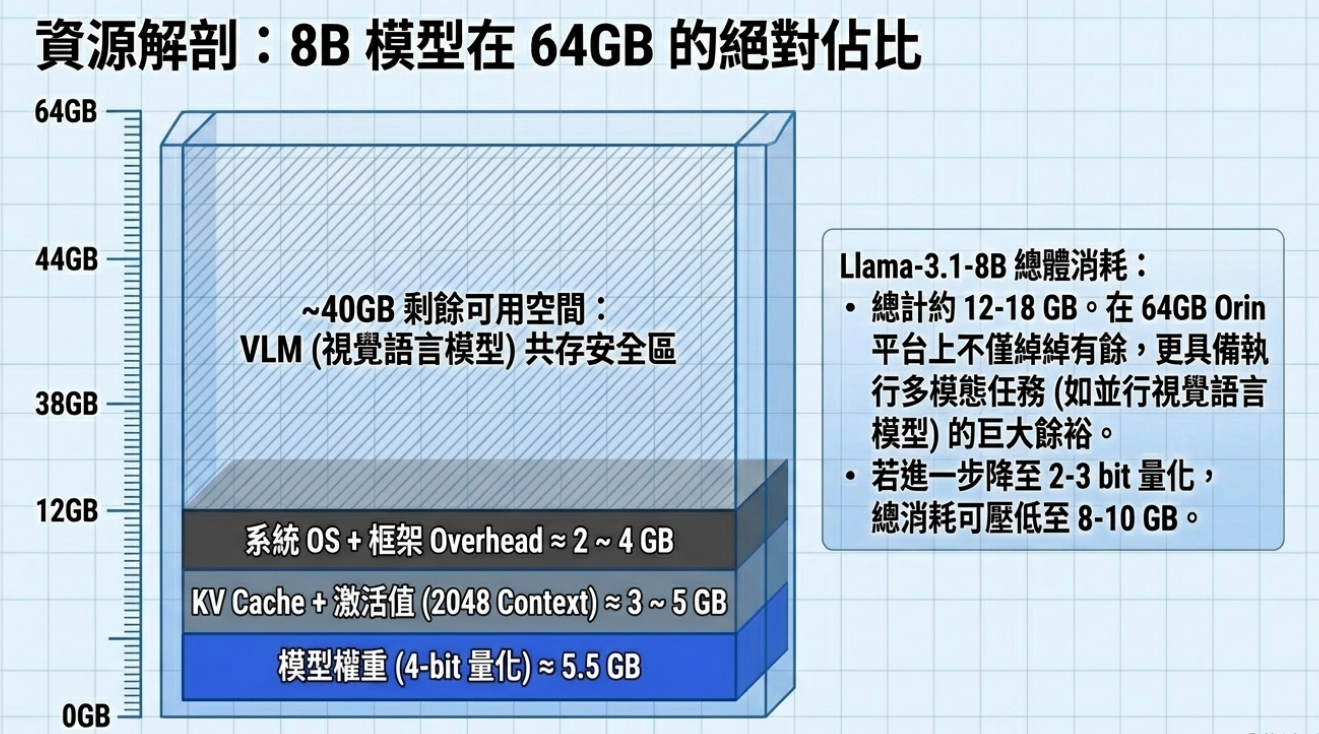

CUDA allocation failed4. Orin 的 64GB 运行 8B 模型资源实测

很多人以为 8B 会占满 64GB,其实完全不会。

4bit + 2048 tokens 配置:**

- 系统 + 框架开销:2–4 GB

- 模型权重:≈5.5 GB

- KV Cache + 激活值:3–5 GB

- 总计:12–18 GB

剩余可用高达 40–44 GB

意味着: ✅ 可同时运行 LLM + VLM(视觉语言模型) ✅ 可多模型并行 ✅ 可长时间稳定运行

5. Orin 全系列硬件部署决策矩阵

硬件型号 | 可用内存 | 适用模型 | Context 容忍度 | 推荐框架 |

|---|---|---|---|---|

AGX Orin 64GB | ~58–62GB | 8B ~ 30B+(量化) | 极高 | LLM + VLM 双模 |

AGX Orin 32GB | ~28–30GB | 7B ~ 13B | 中高 | 默认优化 |

Orin NX 16GB | ~14GB | 7B ~ 8B(限4bit) | 低 | llama.cpp |

Orin Nano 8GB | ~7.6GB | 2B ~ 7B(极限) | 极低 | 关闭 GUI + 极致优化 |

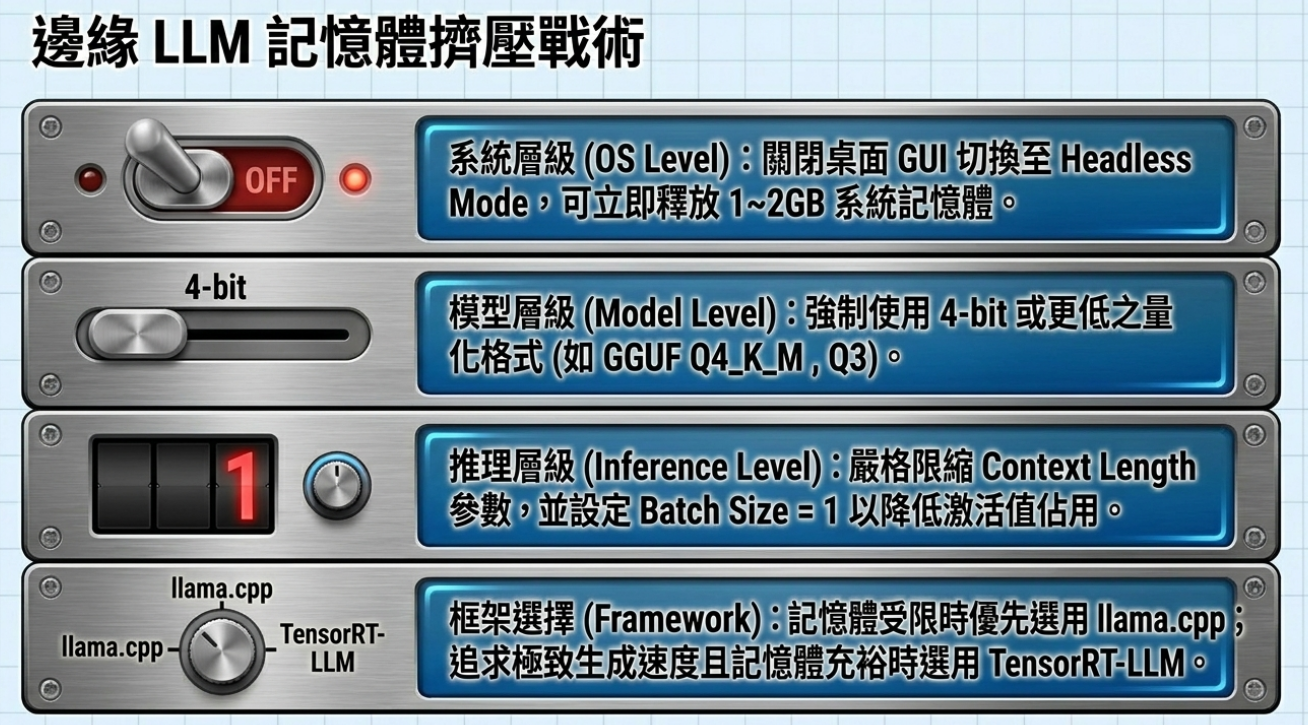

6. 边缘 LLM 四大内存优化战术

1、系统层面:

# 关闭桌面 GUI(立即释放 1–2GB)

sudo systemctl set-default multi-user.target

sudo reboot2、模型层面:

- 强制使用 4bit Q4_K_M

- 优先选择 GGUF 格式

- 避免 FP16 / Q8

3、推理层面:

- Context Length ≤ 2048

- Batch Size = 1

- 缩短 Prompt 长度

- 避免长文本输入

4、框架选择

- 内存极限优先 → llama.cpp

- 速度优先 → TensorRT-LLM

- 多模型服务 → LocalAI

7. 必备监测工具(优化不能靠感觉)

# Jetson 专属系统监测

tegrastats

# 查看系统内存

free -h

# 查看 GPU 负载与共享内存

nvidia-smi8. 总结:3 条永远不变的边缘 LLM 真理

- 统一内存是优势,也是限制,必须精细管理。

- 4bit 量化 + 限制 Context Length = 边缘生存基本法。

- 小设备用 llama.cpp;大设备用 TensorRT-LLM。

只要按照本文配置,Llama-3.1-8B 可在 Jetson Orin 上长时间稳定、高效、安全运行,真正实现边缘 AI 商用价值。

原创声明:本文系作者授权腾讯云开发者社区发表,未经许可,不得转载。

如有侵权,请联系 cloudcommunity@tencent.com 删除。

原创声明:本文系作者授权腾讯云开发者社区发表,未经许可,不得转载。

如有侵权,请联系 cloudcommunity@tencent.com 删除。

评论

登录后参与评论

推荐阅读

目录